Компания Google объявила о начале внедрения новой функции, которая поможет пользователям «лучше понять, как создавался и изменялся тот или иной фрагмент контента».

Это произошло после того, как компания присоединилась к Коалиции за происхождение и подлинность контента (C2PA) — группе крупных брендов, пытающихся бороться с распространением вводящей в заблуждение информации в Интернете — и помогла разработать новейший стандарт Content Credentials. Amazon, Adobe и Microsoft также являются членами комитета.

Google, который собирается выпустить в ближайшие месяцы, заявляет, что будет использовать текущие руководящие принципы Content Credentials (метаданные изображения) в своих параметрах поиска, чтобы добавлять метку к изображениям, которые генерируются или редактируются ИИ, обеспечивая большую прозрачность для пользователей. Эти метаданные включают в себя такую информацию, как происхождение изображения, а также когда, где и как оно было создано.

Однако стандарт C2PA, который дает пользователям возможность отслеживать происхождение различных типов медиа, был отклонен многими разработчиками ИИ, такими как Black Forrest Labs — компанией, стоящей за моделью Flux, которую Grok из X (ранее Twitter) использует для генерации изображений.

Эта маркировка ИИ будет реализована через текущее окно Google About This Image, что означает, что она также будет доступна пользователям через Google Lens и функцию Android ‘Circle to Search’. Когда изображение будет опубликовано, пользователи смогут нажать на три точки над изображением и выбрать “About this image”, чтобы проверить, было ли оно сгенерировано ИИ, — так что это будет не так очевидно, как мы надеялись.

Этого достаточно?

В то время как Google нужно было сделать что-нибудь об изображениях AI в результатах поиска, остается вопрос, достаточно ли скрытой метки. Если функция работает так, как заявлено, пользователям нужно будет выполнить дополнительные шаги, чтобы проверить, было ли изображение создано с помощью AI, прежде чем Google подтвердит это. Те, кто еще не знает о существовании функции About This Image, могут даже не осознавать, что им доступен новый инструмент.

Хотя в видеодипфейках уже были случаи, как в начале этого года, когда финансового работника обманом заставили заплатить 25 миллионов долларов группе, выдававшей себя за его финансового директора, изображения, созданные с помощью ИИ, почти так же проблематичны. Дональд Трамп недавно опубликовал цифровые изображения Тейлор Свифт и ее поклонников, ложно поддерживающих его кампанию за пост президента, а Свифт оказалась жертвой сексуального насилия на основе изображений, когда ее обнаженные фотографии, созданные с помощью ИИ, стали вирусными.

Хотя легко жаловаться на то, что Google делает недостаточно, даже Meta не слишком стремится вытащить кота из мешка. Гигант социальных сетей недавно обновил свою политику, сделав метки менее заметными, переместив соответствующую информацию в меню поста.

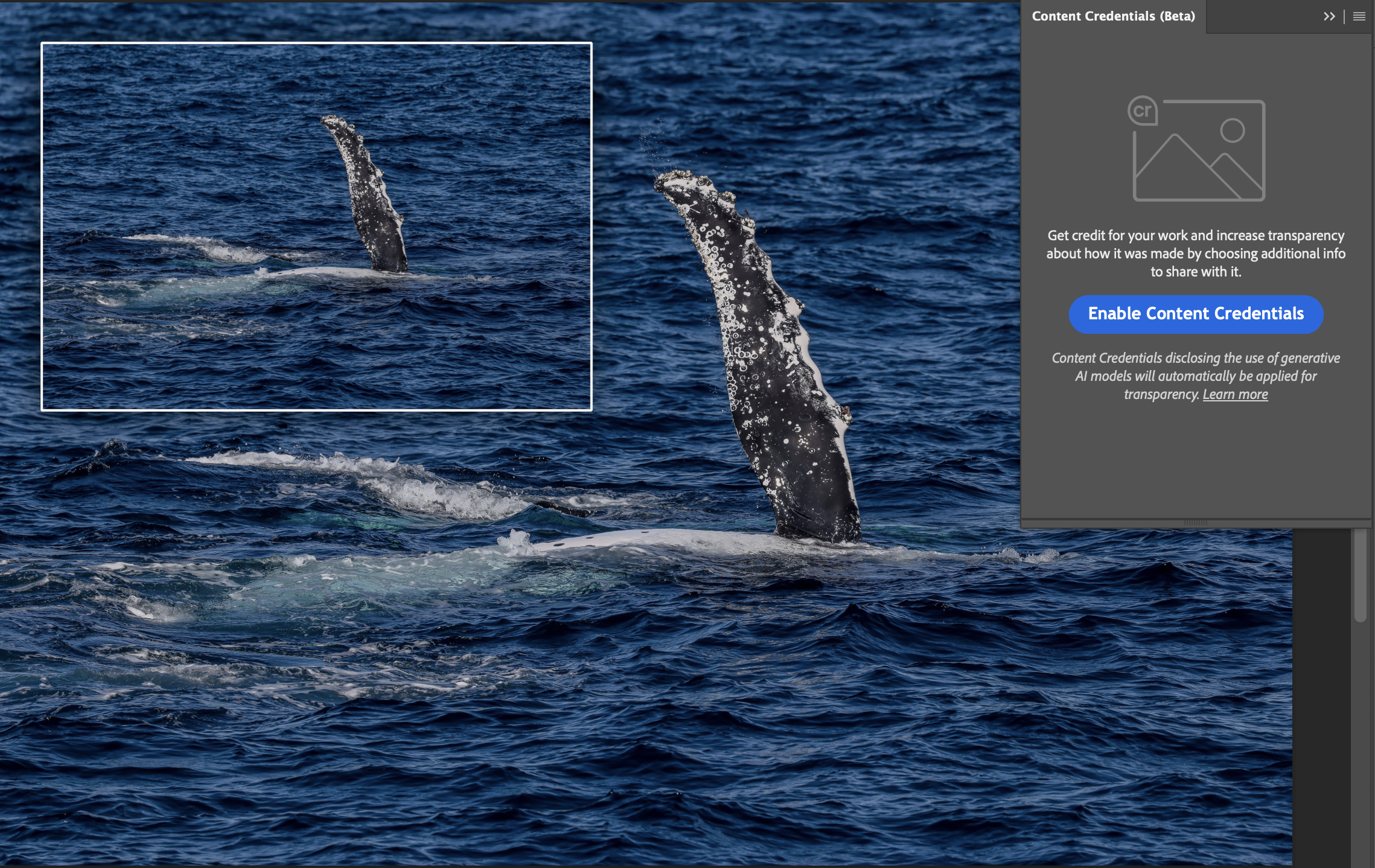

Хотя это обновление инструмента «Об этом изображении» является первым позитивным шагом, потребуются дополнительные агрессивные меры для информирования и защиты пользователей. Больше компаний, таких как производители камер и разработчики инструментов ИИ, также должны будут принять и использовать водяные знаки C2PA, чтобы гарантировать, что эта система будет максимально эффективна, поскольку Google будет зависеть от этих данных. Немногие модели камер, такие как Leica M-11P и Nikon Z9, обладают встроенными функциями Content Credentials, в то время как Adobe реализовала бета-версию как в Photoshop, так и в Lightroom. Но, опять же, использование функций и предоставление точной информации зависит от пользователя.

В исследовании Университета Ватерлоо только 61% людей смогли отличить изображения, созданные ИИ, от настоящих. Если эти цифры точны, система маркировки Google не даст никакой дополнительной прозрачности более чем трети людей. Тем не менее, это позитивный шаг со стороны Google в борьбе за сокращение дезинформации в Интернете, но было бы хорошо, если бы технологические гиганты сделали эти маркировки намного более доступными.